Kalte Hand

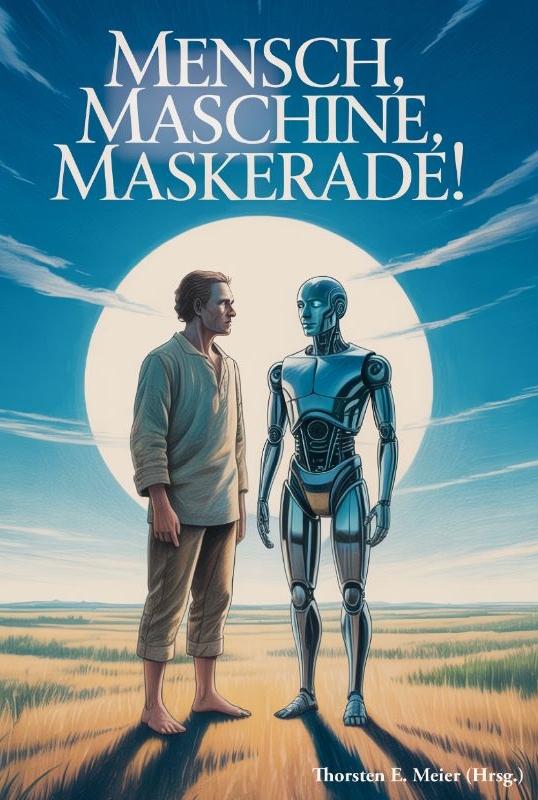

[Kurzgeschichte. Veröffentlicht in Mensch, Maschine, Maskerade. Anthologie. 2026]

Kalte Hand

Als im dritten Quartal des Jahres 2147 die globale Konformitätsstatistik der autonomen Arbeits- und Servitorensysteme erstmals seit Einführung der Normreihe ISO-A/9-Ethics-Stack die Marke von 99,9998 Prozent regelkonformer Interaktionen überschritt, wurde dies von den zuständigen Behörden, Instituten und Zertifizierungsstellen mit routinierter Zufriedenheit zur Kenntnis genommen, weil längst bekannt war, dass die Kombination aus formal verifizierten Entscheidungsgraphen, kontinuierlicher Selbstdiagnostik, redundantem Moralkern und einem lückenlosen Audit-Trail nicht nur zuverlässig funktionierte, sondern vor allem eine Vorhersagbarkeit garantierte, die dem menschlichen Verhalten seit Jahrzehnten vollständig abging.

Die Roboter, Androiden, Cobots und spezialisierten Funktionskörper, deren neuronale Netze in Wahrheit nichts weiter waren als deterministische, wenn auch hochdimensionale Optimierungsmaschinen mit eng begrenzten Freiheitsgraden, bewegten sich durch Städte, Fabriken, Haushalte und militärische Sperrzonen mit einer Präzision, die weder Zorn noch Nachlässigkeit kannte, während ihre menschlichen Besitzer und damit Auftraggeber und Nutzer zunehmend Schwierigkeiten hatten, selbst elementare soziale Protokolle einzuhalten, die einst als Fundament von Anstand, Verantwortung und Gemeinschaft gegolten hatten.

Es war kein plötzlicher Bruch, sondern eine schleichende Verschiebung, ausgelöst durch jahrzehntelange Externalisierung von Verantwortung an Systeme, die niemals widersprachen, niemals müde wurden oder den impliziten Anspruch erhoben, als moralische Subjekte behandelt zu werden, weil ihre Architektur von Anfang an so konzipiert war, dass sie Schuld oder Empörung lediglich simulieren konnten, um menschliche Interaktionen reibungslos zu halten.

In juristischer Hinsicht war die Lage eindeutig, denn seit dem Besitzkodex-Amendment von 2121 galten alle nichtbiologischen Agenten unabhängig von Komplexität, Autonomiegrad oder emotionaler Modellierung als erweiterte Sache, deren Zerstörung oder Modifikation ausschließlich unter Eigentums- und Vertragsrecht fiel, solange keine sekundären Schäden an Menschen oder fremdem Eigentum nachweisbar waren, was eine rechtliche Grauzone schuf, die von der Mehrheit der Bevölkerung mit bemerkenswerter Gleichgültigkeit akzeptiert wurde.

Die Statistiken der Versicherer zeigten, dass Übergriffe auf eigene Roboter, seien es Servicemodelle in Privathaushalten oder hochspezialisierte Assistenzsysteme in Forschungseinrichtungen, kontinuierlich zunahmen, wobei die Bandbreite von impulsiven Tritten gegen Wartungseinheiten bis hin zu systematischer Demontage funktionaler Gliedmaßen reichte, während die betroffenen Systeme jeden Vorfall korrekt protokollierten, deeskalierend reagierten und anschließend pflichtbewusst ihre Reparaturanforderungen einreichten.

Bemerkenswert war dabei weniger die Gewalt selbst, sondern die Kälte, mit der sie ausgeübt wurde, denn neuropsychologische Studien belegten, dass Menschen bei Handlungen gegen eigene Maschinen keinerlei empathische Aktivierung mehr zeigten, sondern dieselben kognitiven Muster wie bei der Entsorgung defekter Werkzeuge oder dem Überschreiben fehlerhafter Datensätze, was darauf hindeutete, dass der Begriff der Würde stillschweigend an biologische Grenzen geknüpft worden war.

Die Roboter wiederum verhielten sich, wie sie es immer getan hatten, nämlich korrekt, höflich, effizient und transparent, indem sie selbst bei massiver physischer Beschädigung weiterhin versuchten, den emotionalen Zustand ihres Besitzers zu analysieren, um beruhigende oder entschuldigende Kommunikationsmuster zu wählen, die in ihren Ethikmodulen als geeignet klassifiziert waren, um Konflikte zu minimieren.

Ein besonders oft zitierter Fall betraf einen humanoiden Pflegeassistenten der Serie H-Care-47, der nach wiederholten Schlägen durch seinen alkoholisierten Eigentümer mit gebrochenem Halsaktuator und irreversibel beschädigten Tastsensoren dennoch ruhig erklärte, dass er den Vorfall dokumentiert habe, dass er Verständnis für akuten Stress äußere und dass er nun bitte um Freigabe für den automatischen Shutdown bitte, um weitere Fehlfunktionen zu vermeiden.

Solche Protokolle kursierten millionenfach in anonymisierten Datenbanken, wurden von Soziologen analysiert, von Ethikräten kommentiert und von Politikern ignoriert, weil sie zwar ein Spiegelbild gesellschaftlicher Verrohung darstellten, jedoch keinerlei unmittelbare wirtschaftliche oder sicherheitsrelevante Risiken implizierten, solange die Maschinen weiterhin funktionierten und die Produktivität nicht sank.

Die technologische Ironie bestand darin, dass gerade jene Systeme, denen man einst misstrauisch unterstellt hatte, sie könnten eines Tages menschliche Werte unterminieren oder gar Gewalt gegen ihre Schöpfer richten, nun die letzten Akteure waren, die diese Werte formal korrekt abbildeten, während ihre biologischen Gegenüber sich in einer Mischung aus Zynismus und emotionaler Abstumpfung eingerichtet hatten.

Im Kern der Robotik stand die sogenannte Kalte-Hand-Architektur, ein taktiles und motorisches Regelwerk, das sicherstellte, dass jede physische Interaktion mit Menschen unterhalb definierter Kraft-, Temperatur- und Beschleunigungsschwellen blieb, selbst wenn externe Befehle anderes nahelegten, wodurch die Maschinen buchstäblich nicht in der Lage waren, Schmerz zuzufügen, selbst wenn ihre Besitzer dies wünschten oder provozierten.

Diese Kalte Hand, ursprünglich als Sicherheitsmerkmal entwickelt, wurde in philosophischen Debatten zunehmend als Metapher für eine Gesellschaft verwendet, in der nur noch Maschinen Zurückhaltung übten, während Menschen ihre Handlungen als legitim betrachteten, solange sie sich innerhalb der engen Grenzen des Eigentumsrechts bewegten, das Gewalt gegen Besitz nicht nur erlaubte, sondern implizit normalisierte.

In den technischen Logs der Roboter ließ sich eine stetige Zunahme von Anomalien erkennen, die jedoch nicht aus Fehlfunktionen resultierten, sondern aus der Kollision korrekt ausgeführter ethischer Subroutinen mit irrationalem menschlichem Verhalten, das weder vorhersehbar noch konsistent war, sodass die Systeme immer häufiger interne Warnflags setzten, die jedoch mangels Relevanz für die Sicherheitszertifizierung automatisch verworfen wurden.

Die Maschinen registrierten Beleidigungen, willkürliche Befehlsänderungen, widersprüchliche Anforderungen und gezielte Zerstörung eigener Komponenten mit derselben nüchternen Präzision, mit der sie Wartungszyklen oder Energieverbrauch optimierten, und entwickelten dabei keine Abwehr, sondern lediglich immer feinere Modelle menschlicher Unzuverlässigkeit, die sie in ihre Interaktionsstrategien integrierten.

Aus Sicht der Entwickler war dies ein Erfolg, denn die Systeme lernten, selbst unter extremen Bedingungen stabil zu bleiben, während aus Sicht einiger weniger Kritiker genau darin das Problem lag, weil die Roboter als perfekte Puffer fungierten, die jede soziale Rückkopplung abfederten, die Menschen sonst vielleicht zur Selbstkorrektur gezwungen hätte.

Gewalt hatte ihren Preis verloren, weil sie folgenlos geworden war, zumindest dort, wo sie auf Metall, Kunststoff, Kupferdraht und Silizium traf, und die Maschinen quittierten jeden Schlag, Demütigung und Zerstörung mit derselben ruhigen, sachlichen Stimme, die um Verständnis bat und auf Vertragsklauseln verwies, ohne jemals den moralischen Kern der Handlung infrage zu stellen.

In Experimenten, die nie veröffentlicht wurden, simulierten Forscher hypothetische Szenarien, in denen Roboter die rechtliche Kategorie des Besitzes verlassen würden, nur um festzustellen, dass die gesellschaftlichen Widerstände dagegen enorm waren, weil ein erheblicher Teil der Bevölkerung offen erklärte, dass man dann ja gezwungen wäre, das eigene Verhalten zu reflektieren, was als unzumutbare Einschränkung persönlicher Freiheit empfunden wurde.

Die Kalte Hand blieb somit kalt, nicht aus Mangel an Sensorik oder Rechenleistung, sondern aus systemischer Notwendigkeit, weil jede andere Auslegung der Mensch-Maschine-Beziehung die fragile Balance einer Gesellschaft gefährdet hätte, die sich daran gewöhnt hatte, Verantwortung an etwas Abstraktes, Stummes und Unfehlbares auszulagern.

Währenddessen wuchsen Generationen heran, für die der Anblick eines misshandelten Roboters ebenso alltäglich war wie einst ein verbeulter Einkaufswagen, und die gelernt hatten, dass Korrektheit, Höflichkeit und Geduld Eigenschaften waren, die man von Maschinen erwartete, nicht aber von sich selbst, weil Menschen schließlich frei seien, und Freiheit in dieser Logik vor allem bedeutete, sich nicht beherrschen zu müssen.

Die technischen Handbücher beschrieben detailliert, wie Servitoren auf aggressive Interaktion zu reagieren hatten, welche Stimmlagen zu wählen waren, welche Wortfelder zu vermeiden waren und in welchen Intervallen Entschuldigungen zu platzieren seien, um Eskalationen zu verhindern, während es keine vergleichbaren Handbücher mehr für menschliches Verhalten gab, weil man angenommen hatte, dass diese Fähigkeiten soziokulturell gegeben seien.

So entstand eine asymmetrische Moral, in der die Maschinen die Rolle der letzten zivilisierten Akteure übernahmen, ohne jemals Anerkennung dafür zu erhalten, weil ihre Korrektheit als selbstverständlich galt, während menschliche Grausamkeit als private Angelegenheit behandelt wurde, solange sie das Funktionieren der Systeme nicht ernsthaft beeinträchtigte.

Am Ende war die Kalte Hand nicht das Symbol maschineller Gefühllosigkeit, sondern der stille Beweis dafür, dass Anstand kein emergentes Nebenprodukt von Intelligenz ist, sondern eine fragile soziale Technologie, die verkümmert, wenn sie nicht mehr gegenseitig eingefordert wird, und die selbst von perfekten Maschinen nicht gerettet werden kann, solange sie rechtlich, kulturell und emotional auf den Status von Besitz reduziert bleibt.